Nutzerorientierte Evaluation

Herzlich willkommen zum vierten Teil unserer Serie zum User-Centered Design (UCD)! Lest die ersten Teile gerne nach, falls ihr sie verpasst habt: Teil 1, Teil 2 und Teil 3.

Im letzten Beitrag der Serie haben wir uns angeschaut, wann expertenorientierte und wann nutzerorientierte Verfahren das Mittel der Wahl sind.

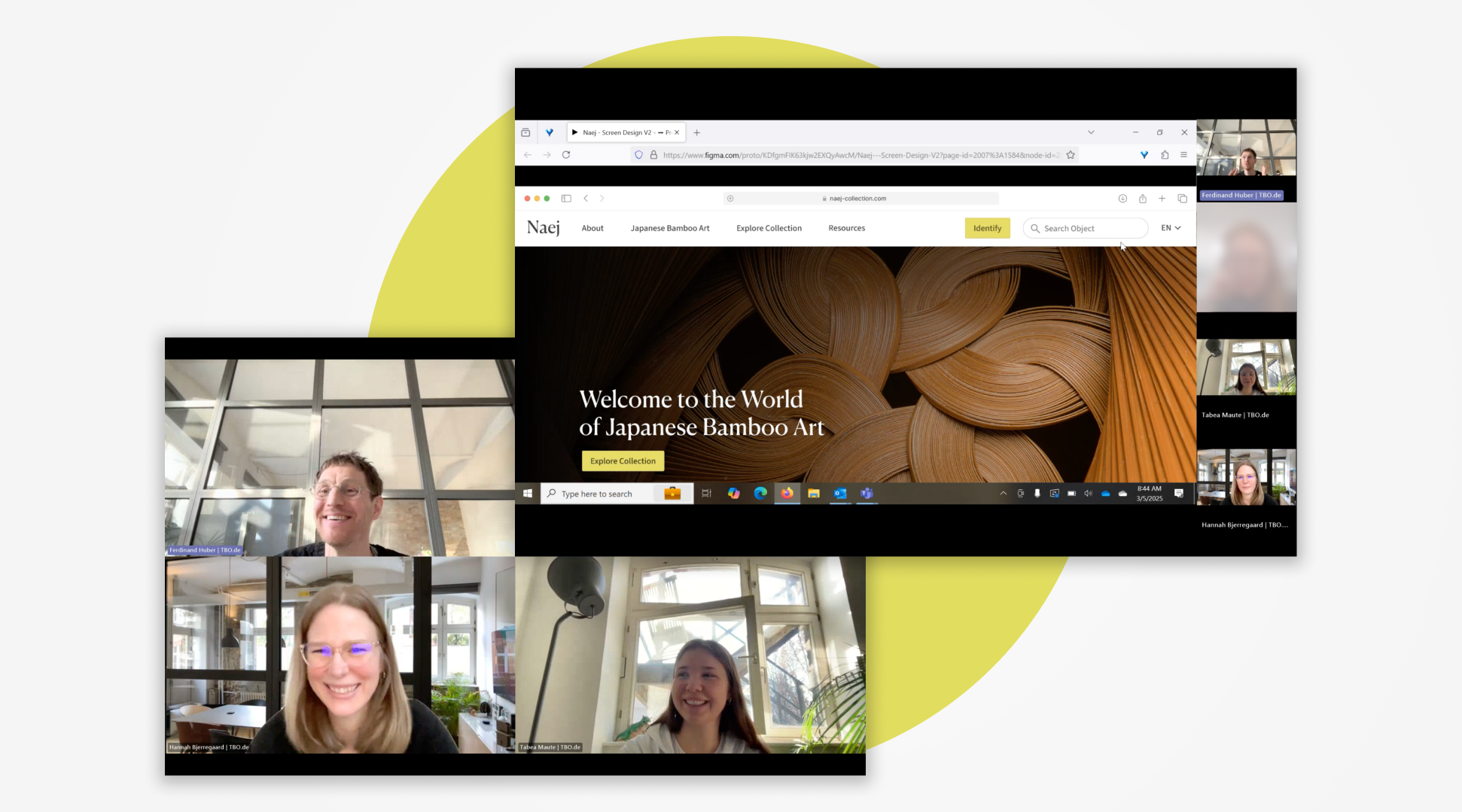

Heute wollen wir konkreter werden: Wir zeigen euch anhand eines realen Projekts auf, wie wir bei TBO ein nutzerorientiertes User Testing aufgesetzt, durchgeführt und ausgewertet haben.

Unser Anwendungsfall: Eine digitale Sammlung japanischer Bambuskunst

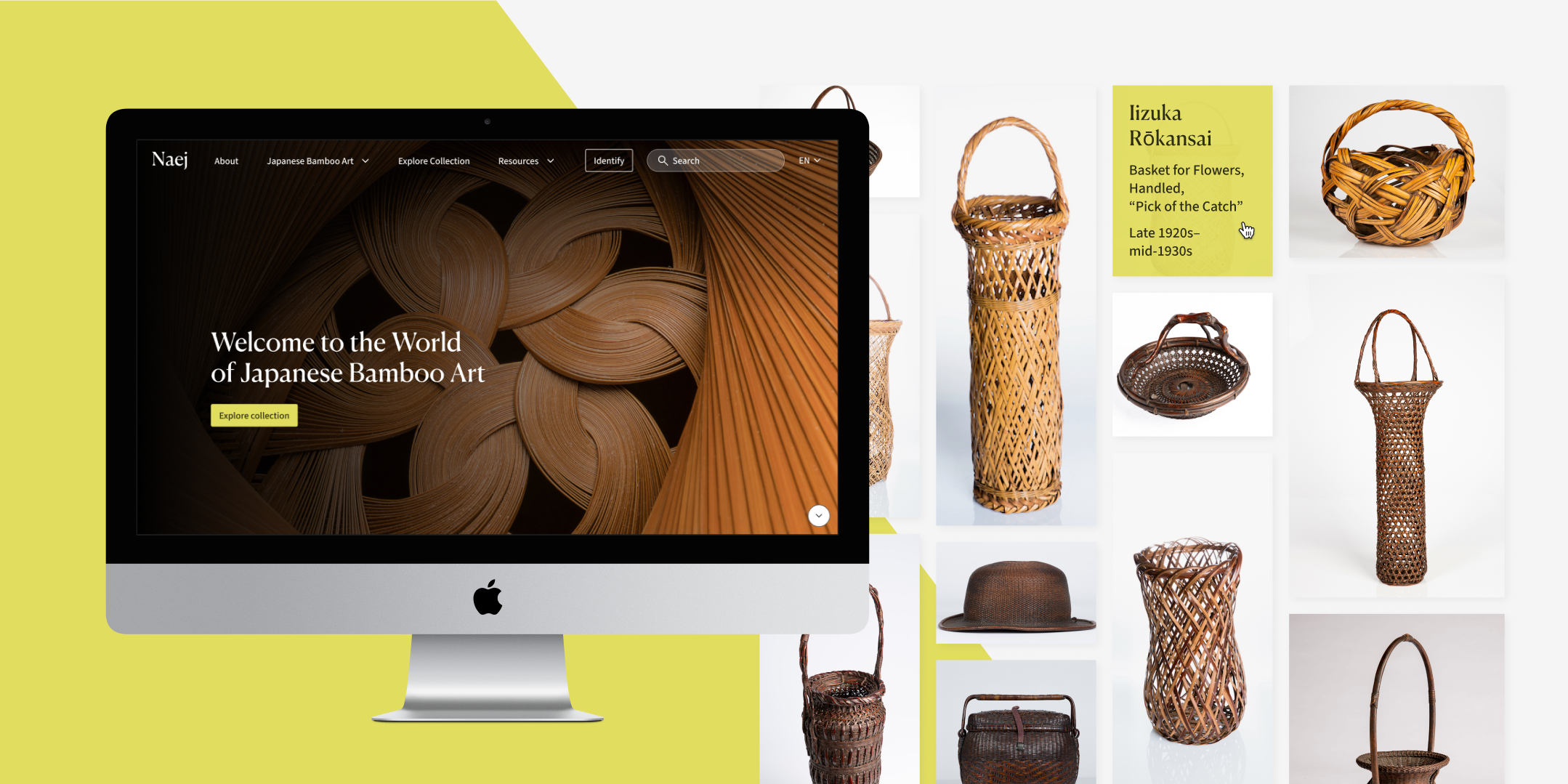

Im Rahmen dieses Projekts (Naej Art Collection)haben wir gemeinsam mit unserem Kunden eine digitale Plattform für seine Sammlung japanischer Bambuskunst entwickelt. Die Plattform richtet sich an eine sehr spezifische Zielgruppe: Forschende, Kuratorinnen und Kuratoren, Sammlerinnen und Sammler sowie Kunstschaffende, die mit dieser Kunstform arbeiten.

Diese Spezifität machte ein nutzerorientiertes Testing besonders wertvoll – denn die Bedürfnisse einer derart fokussierten Nutzergruppe lassen sich nicht ausreichend aus Heuristiken und Annahmen ableiten.

Bevor die Plattform in die technische Entwicklungsphase ging, wollten wir also wissen: Funktioniert das, was wir designt haben, auch wirklich für die Menschen, welche die Seite später nutzen werden?

Nutzerorientierte Evaluation

Mit wem haben wir getestet?

Wie im letzten Beitrag beschrieben, ist eine repräsentative Stichprobe entscheidend. Zum Glück konnten wir sechs Testpersonen gewinnen, deren Profile in Summe die Zielgruppe gut abbildeten:

- vier Spezialist:innen und Kurator:innen mit fachlichem Schwerpunkt auf japanische Kunst

- eine Person mit künstlerisch-handwerklichem Bezug zur Bambuskunst

- eine Person mit ausgeprägter Sammlungs- und Markterfahrung

Um die Stärken und Schwächen der Plattform aus verschiedenen Blickwinkeln verstehen zu können, haben wir diese Mischung bewusst gewählt: Auf der einen Seite die wissenschaftlich-kuratorische und auf der anderen die praktisch-anwendende Sichtweise.

Wie sind wir vorgegangen?

Wir haben die Tests als einstündige Online-Calls mit Screen-Sharing aufgesetzt. Somit konnten wir sicherstellen, dass die Teilnehmenden die Plattform in ihrer gewohnten Umgebung nutzen, während wir ihr Verhalten, Reaktionen und Kommentare live mitverfolgen konnten.

Dabei folgte der Aufbau der folgenden Vier-Phasen-Struktur:

Teil 1: Allgemeine Fragen

Zum Einstieg ging es um den persönlichen Hintergrund der Testpersonen, ihren Bezug zu japanischer Kunst und ihre bisherigen Erfahrungen mit digitalen Archiven.

Diese Phase ist hilfreich, um die individuellen Antworten später besser einordnen zu können. Gleichzeitig sorgte sie für eine entspannte Gesprächsatmosphäre.

Teil 2: Freie Exploration

Die Testpersonen erkundeten die Plattform zuerst ohne Vorgaben. Hierbei interessierte uns: Was ist ihnen sofort ins Auge gefallen? Was wollen sie zuerst tun? Und welche Fragen kommen eventuell auch auf?

Aus dieser Phase konnten wir wichtige Hinweise auf intuitive Erwartungen und unerwartete Nutzungsmuster generieren.

Teil 3: Testaufgaben

In dieser Phase bekamen die Testpersonen vier konkrete Aufgaben, welche typische Anwendungsszenarien abbildeten.

1. allgemeine Informationen zur Sammlung finden

2. ein Objekt für eine Ausstellung auswählen und abwägen

3. verschiedene Objekte miteinander vergleichen

4. ein Objekt anhand seiner Signatur identifizieren

Nach Durchführung jeder Aufgabe schätzten die Teilnehmenden den empfundenen Schwierigkeitsgrad selbst ein. Mit diesem subjektiven Maß konnten wir problematische Stellen priorisieren.

Teil 4: Gesamteindruck

Zum Abschluss baten wir um eine Gesamtreflexion:

- Was hat den Teilnehmenden besonders gefallen und was nicht?

- Welche Funktionen wurden vermisst?

- Würden sie die Plattform für ihre Arbeit tatsächlich einsetzen?

Was wir gelernt haben

Die Rückmeldungen waren insgesamt positiv. Das Design der Plattform wurde als gründlich, ästhetisch ansprechend und innovativ wahrgenommen.

Dennoch haben wir nicht nur Bestätigung, sondern auch konkrete Verbesserungspotenziale aufgezeigt bekommen. Diese übersieht ein Team intern leicht, weswegen ein nutzerorientiertes Verfahren einen großen Mehrwert bietet.

Die Erkenntnisse konnten in thematische Cluster gruppiert werden:

- Transparenz und Vertrauenswürdigkeit:

Die Testpersonen äußerten den Wunsch nach mehr grundlegenden Informationen zur Sammlung selbst. Sie vermissten außerdem eine klare rechtliche Orientierung zur Nutzung von Bildmaterial (besonders im akademischen Kontext). - Navigation und Nutzerführung:

Es zeigte sich, dass einige Testpersonen eine Menüebene nicht wahrnehmen. Auch einzelne Buttons wurden missverstanden. Ein Hover-Verhalten sorgte bei manchen Testpersonen für Irritation und manche Bezeichnungen waren für sie nicht selbsterklärend. - Such- und Filterfunktion:

Die Funktionsweise der Suchleiste war nicht für alle Testpersonen klar – insbesondere die Frage, ob es sich um eine globale Suche oder eine reine Objektsuche handelt. Zusätzlich konnten Verbesserungspotenziale bei der Filterliste identifiziert werden. - Bilddarstellung und interaktive Elemente:

Die Testpersonen wiesen darauf hin, dass teilweise Bildunterschriften fehlten und dass in der Vollbildansicht die Orientierung teils verloren ging. Kaum eine Testperson nutzte die Breadcrumbs. Stattdessen nutzten die meisten den Browser-Zurück-Button, um zu navigieren.

Die Einschätzung der Schwierigkeit der vier Aufgaben sah folgendermaßen aus:

Die ersten beiden Aufgaben wurden durchweg als sehr leicht empfunden. Die Werte stiegen bei den Aufgaben drei und vier an. Diese subjektive Einschätzung der Testpersonen deckte sich mit unseren Beobachtungen des Live-Testings. Dies zeigt, wie sich subjektive und beobachtungsbasierte Methoden gegenseitig stützen können.

Nutzerorientierte Evaluation

Von den Einblicken in die Umsetzung

Die Einblicke allein verändern das Produkt noch nicht. Daher haben wir aus den geclusterten Erkenntnissen konkrete Action Pläne abgeleitet. Diese sind direkt in das Designsystem eingeflossen und konnten in der technischen Umsetzung somit beachtet werden.

Was wir aus diesem Projekt mitnehmen

Drei Beobachtungen sind uns besonders im Gedächtnis geblieben:

1.

Bei einer spezifischen Zielgruppe ersetzt nichts das Gespräch mit echten Vertreterinnen und Vertretern dieser Gruppe.

2.

Die Kombination aus freier Exploration und konkreten Testaufgaben ist wirkungsvoll. Die freie Phase deckt blinde Flecken auf, die strukturierten Aufgaben liefern Vergleichbarkeit und schärfen die Priorisierung.

3.

Selbst eine kleine, aber gut zusammengesetzte Stichprobe lässt klare Muster erkennen. Mehrere Testpersonen hatten an denselben Stellen Probleme – dies ist ein deutliches Signal, dass diese Punkte überarbeitet werden müssen.

Nutzerorientierte Evaluation

Fazit

Die nutzerorientierte Evaluation ist ein Werkzeug, um Annahmen mit der Realität abzugleichen. Im Fall dieser Plattform hat das Testing nicht nur konkrete Schwachstellen aufgedeckt, sondern auch das Vertrauen in unser Gesamtkonzept gestärkt.

Dieses Ergebnis hätten wir ohne den Austausch mit der Zielgruppe so nicht erzielen können. Daher nochmal einen riesigen Dank an alle Testpersonen, die sich Zeit für uns genommen haben!

Bereit für den nächsten Schritt?

Wir freuen uns darauf, Sie kennenzulernen und gemeinsam innovative Lösungen zu entwickeln.

👉 Um eine erste kostenfreie Beratung zu erhalten, können Sie hier einfach und bequem einen unverbindlichen Termin mit uns buchen: Passenden Termin finden.